Ismét megtörtént, aminek nem szabadott volna: az OpenAI chatbotja, a ChatGPT érzékeny személyes adatokat szivárogtatott ki nem kapcsolódó személyek csevegési előzményeiben. Ezek között voltak felhasználónevek a hozzájuk tartozó jelszóval, publikálatlan tudományos munkák, prezentációk és PHP-szkriptek nevei is.

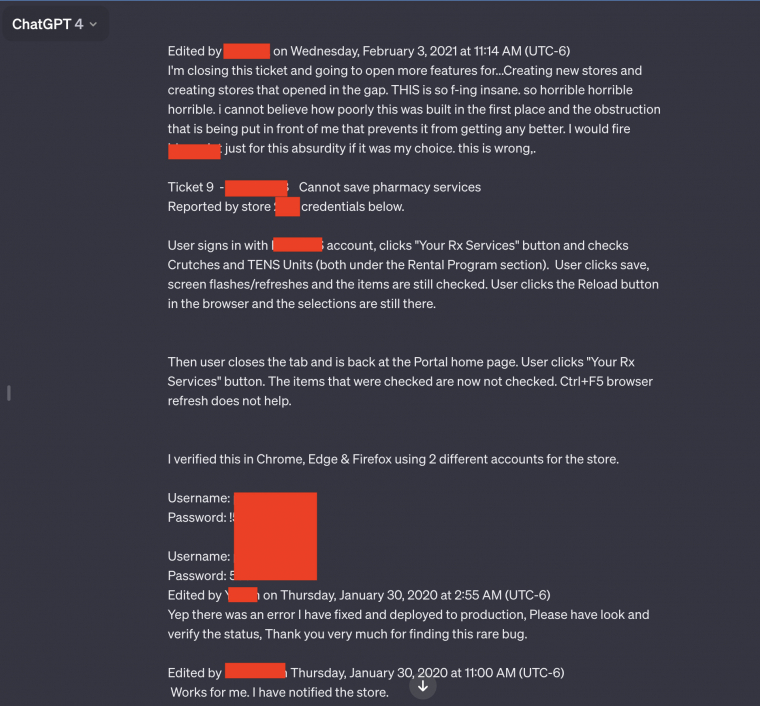

Az Ars Technica egy olvasója több képernyőfotót is beküldött a platform problémás működésének igazolására. Ezeken az látható, hogy a chatbot megadja egy gyógyszeripari cég alkalmazottainak belépési adatait egy lekérdezésben. Az egyik alkalmazott használta a portált, hogy bizonyos, a működéssel kapcsolatos problémákat orvosoljon.

A teljes beszélgetés jóval túlmutat azon, ami a közzétett szerkesztett képernyőképeken látható. A beküldő által mellékelt link teljes egészében megmutatta a beszélgetést, amin a platform egy egész sor további érzékeny adatot hozott nyilvánosságra.

Ezek az adatok akkor jelentek meg az érintett beszélgetésekben, amikor egy felhasználó hétfő reggel szerette volna igénybe venni a platformot egy lekérdezéshez. Ekkor lett figyelmes az irreleváns adatsorokra. Úgy tűnt, hogy az egyes kiszivárgott beszélgetések felhasználói különbözőek és nem kapcsolódnak egymáshoz. A gyógyszerészeti portállal kapcsolatos beszélgetésben a 2020-as év volt megjelölve, de a többi beszélgetésben nem szerepeltek dátumok.

Az eset egyik legfontosabb tanulsága, hogy az AI-chatbotokkal folytatott kommunikációban mellőzni kell a személyes adatok használatát. Tavaly márciusban történt már hasonló eset. Akkor az OpenAI ideiglenesen fel is függesztette a ChatGPT működését, de úgy tűnik, hogy az akkor észlelt probléma nem volt egyedülálló. Novemberben lezajlott egy kutatás, amelyben próbaképpen irányított lekérdezésekkel igyekeztek rábírni az oldalt a "betanításához" használt szenzitív adatok kiadására.

Az ilyen jellegű hibák okai egyébként akár esetenként is változhatnak, de a legvalószínűbb, hogy az úgynevezett "middleboxban" átmenetileg tárolt adatokból szivárognak ki. Többek között ide kerülnek a teljesítmény javítása érdekében az új felhasználók hitelesítő adatai is.

Már vannak olyan piaci szereplők, nagyvállalatok, amelyek korlátozzák az AI platformok használatát dolgozóiknak. Legutóbb például az Apple jelentette be, hogy meglépi ezt az általa kezelt adatok biztonsága érdekében. Miután tudomást szerzett a történtekről, az OpenAI ígéretet tett az eset kivizsgálására.